Neironu tīkls (saukts arī par ANN vai mākslīgo neironu tīklu) ir programmatūras un matemātisku modeļu kopums, kas veidots pēc bioloģisko neironu parauga. Tā vietā, lai vienā solī risinātu pilnu uzdevumu, tīkls sadala sarežģītu problēmu mazākos, savstarpēji saistītos uzdevumos — atsevišķas vienības (mākslīgie neironi) apstrādā daļas informācijas un kopā sniedz gala rezultātu. Neironu tīkli ir viena no metodēm mākslīgi inteliģentu sistēmu izveidē, un to uzvedība tiek noteikta ar parametriem (svariem) un aktivācijas funkcijām.

Darbības princips

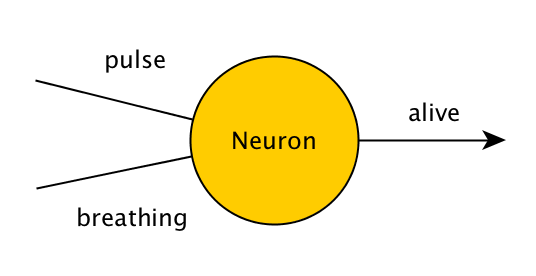

Katrs mākslīgais neirons saņem vienu vai vairākus ievades signālus, reizinot tos ar svariem, summē tos un pielieto aktivācijas funkciju, lai radītu izvadi. Šis process tiek saukts par forward pass. Neironu tīkli parasti ir sakārtoti slāņos:

- Ievades slānis — saņem izejas datus (piem., attēla pikseļus vai teksta vektorus).

- Slēptie slāņi — vairāki slāņi, kuros tiek iegūtas abstraktākas iezīmes.

- Izvades slānis — nodrošina gala prognozi vai lēmumu.

Dažādu tipu tīkli (piem., tieši saistītie jeb feedforward, konvolūciskie, rekursīvās arhitektūras) izmanto dažādas savienojumu un apstrādes stratēģijas.

Apmācība un mācīšanās

Neironu tīkli ir mašīnmācīšanās piemērs — tie maina savus parametrus, mācoties no datiem. Apmācības galvenie soļi ir:

- Definēt zaudējuma (loss) funkciju, kas mēra prognozes un patiesības atšķirību.

- Veikt forward pass, aprēķināt zaudējumu un tad izplatīt kļūdu atpakaļ caur tīklu (backpropagation), lai iegūtu gradientus.

- Atjaunināt svarus, izmantojot optimizētāju (piem., gradientu dilstošo jeb gradient descent, Adam u.c.).

Apmācībā var izmantot dažādus pieejas veidus: uzraudzīta mācīšanās (labelēti piemēri), neuzraudzīta mācīšanās (klasterēšana, dimensiju samazināšana) un pastiprināšanas mācīšanās (mācība, balstoties uz atalgojumu par darbību sekām).

Dziļās mācīšanās loma

Ja tīkls ir liels un satur daudz slēpto slāņu, to parasti sauc par dziļu neironu tīklu. Dziļas neironu arhitektūras spēj automātiski izvilkt sarežģītas iezīmes no izejas datiem, taču tam bieži ir nepieciešams liels datu apjoms un skaitļošanas resursi — reizēm miljoni vai pat miljardiem piemēru, īpaši dziļas mācīšanās uzdevumos.

Piemēri un populāras arhitektūras

- Perceptrons — vienkāršs lineārais neirons, pamatideja klasifikācijai.

- Multislāņu perceptrons (MLP) — vairākslāņu tīkla paraugs vispārējai funkciju aproksimācijai.

- Konvolūciskie neironu tīkli (CNN) — īpaši piemēroti attēlu un video analīzei.

- Rekursīvie un ilgtermiņa atmiņas tīkli (RNN, LSTM, GRU) — paredzēti secīgu datu (piem., laika rindas, teksta) apstrādei.

- Transformer arhitektūra — pašpievēršanās (self-attention) mehānisms, plaši izmantots dabiskās valodas apstrādē un modeļos kā GPT vai BERT.

Pielietojumi

Neironu tīkli tiek izmantoti daudzās jomās, piemēram:

- Attēlu atpazīšana un medicīniskā attēlu analīze (diagnozes atbalsts).

- Dabiskās valodas apstrāde (tulkošana, teksta ģenerēšana, čatboti).

- Tālredzīga balss un runas atpazinība.

- Autonomās transporta sistēmas un robotika.

- Finanšu prognozēšana, krāpšanas atklāšana un rekomendāciju sistēmas.

Ierobežojumi un izaicinājumi

Jāņem vērā arī trūkumi un riski:

- Datu un resursu prasības: kvalitatīvi, daudz un labi anotēti dati un spēcīga aparatūra (GPU/TPU) bieži ir nepieciešami.

- Pārpielāgošanās (overfitting): tīkls var labi darboties uz treniņu datiem, bet slikti vispārināt uz jauniem datiem.

- Skaidrojumu trūkums: daudzi dziļie modeļi ir “melnie kasti”, kas apgrūtina rezultātu interpretāciju.

- Bias un ētika: modeļi var pastiprināt neobjektivitātes vai diskrimināciju, ja treniņu dati ir šauri vai aizspriedumaini.

Praktiski padomi

- Sāciet ar vienkāršiem modeļiem un dati augošā sarežģītībā.

- Izmantojiet regularizācijas metodes (dropout, L2), datu paplašināšanu (data augmentation) un krustvalidāciju, lai mazinātu overfittingu.

- Apsveriet pārmācīšanu (transfer learning) no jau apmācītiem modeļiem, ja datu ir maz.

- Uzraugiet modeļa veiktspēju uz atsevišķas testa kopas un evaluējiet to dažādos metriku aspektos.

Kopumā neironu tīkli ir jaudīgs rīks, kas spēj risināt ļoti dažādus praktiskus uzdevumus, bet to veiksmīgai izmantošanai nepieciešams saprast gan to teorētisko pamatā, gan praktiskos ierobežojumus.